HD5670对决GT240

在2009年末,ATI为我们带来了基于DirectX 11的Radeon HD5870显卡。它采用第二代40nm工艺制造、搭载第四代GDDR5显存、拥有1600个流处理器、Eyeinfinty多屏显示技术、超低待机功耗等。最为关键的是Radeon HD5000系列产品给了用于一把打开DirectX 11这扇大门的钥匙。

而如今以迪兰恒进和蓝宝石为首的两家AIB已经展开了剧烈的价格战,这在NVIDIA中端重磅炸弹GTS450上市之前有重要意义。今天我们对战的主角是经历过多次降价的HD5670 640SP版本和HD5670 400SP版本,而对手则是已经非常老迈的Geforce 9800GT和发布已久的GT240。目前他们同处与500-600元价位,是消费者选择显卡的重要价格段。

HD5000系列的3大看家技术

ATI在确认了HD5870的优势之后,不断细化市场,诞生了以下几个定位卓越市场控制力优秀的产品:

● HD5970 单卡双芯设计,代表了目前单卡GPU顶级性能;

● HD5870 最强单卡单芯设计,在功耗和发热可控的情况下提供优秀的3D性能;

● HD5830 高性能级别GPU产品,流处理器数量精简到1120个,让用户可以用更低的价格买到高端GPU;

● HD5770 拥有和GTX260+相仿的性能,但是999元的售价非常切合主流用户的消费心理;

● HD5670 超越NVIDIA的GT240,和9800GT平起平坐,价格上具有一定优势;

● HD5550 在500价位上提供了DirectX11、Eyefinity和Stream等技术支持,320个流处理器让它压制了对手GT220的进攻,超低价格和新技术是主要卖点。

对于我国的八荣八耻,相信国民们在熟悉不过了,其实,这样的理念可以用于任何事物,如果我们能深入了解,那么,我们会从中获得收获。比如,我们在购买显卡前也应该熟知显卡的荣与耻,在DX11时代,DX11显卡在设计特性方面就有着他们荣与耻,我们要说的四要四不要就是如此,通过四要四不要来引导消费者做出正确的选择,购买的更具价值的产品。

在下文分析中,我们将逐渐为读者呈现A卡在HD5000系列中的特性和性能优势,通过这篇文章的分析和后期性能对比,相信在400-600元价格段中,读者能够找到适合自己的显卡。同时对于已经逐渐陈旧的技术,用户应该在日后的选购过程中注意回避这类核心较老的对新技术支持乏力的产品。

ATI黄金架构优势与特性

● ATI黄金架构优势与特性

AMD从R600核心开始,一直延续着上述理念设计GPU产品,R600身上有很多传统GPU的影子,其Stream Processing Units很像上代的Shader Units,它依然是传统的SIMD架构。这些SIMD架构的5D ALU使用VLIW技术,可以用一条指令完成多个对数值的计算。

由于内部的5个1D ALU共享同一个指令发射端口,因此宏观上R600应该算是SIMD(单指令多数据流)的5D矢量架构。但是R600内部的这5个ALU与传统GPU的ALU有所不同,它们是各自独立能够处理任意组合的1D/2D/3D/4D/5D指令,完美支持Co-issue(矢量指令和标量指令并行执行),因此微观上可以将其称为5D Superscalar超标量架构。

AMD的流处理器结构变化

SIMD虽然很大程度上缓解了标量指令执行效率低下的问题,但依然无法最大限度的发挥ALU运算能力,尤其是一旦遇上循环嵌套分支等情况,SIMD在矢量处理方面高效能的优势将会被损失殆尽。同时VLIW的效率依赖于指令系统和编译器的效率。SIMD加VLIW在通用计算上弱势的原因就在于打包发送和拆包过程。

NVIDIA从G80开始架构作了变化,把原来的4D着色单元彻底打散,流处理器不再针对矢量设计,而是统统改成了标量运算单元。每一个ALU都有自己的专属指令发射器,初代产品拥有128个这样的1D运算器,称之为流处理器。这些流处理器可以按照动态流控制智能的执行各种4D/3D/2D/1D指令,无论什么类型的指令执行效率都能接近于100%。

AMD所使用的SIMD结构流处理器,具有非常明显的优势就是执行全4D指令时简洁高效,对晶体管的需求量更小。而NVIDIA为了达到MIMD流处理器设计,消耗了太多晶体管资源,同时促使NVIDIA大量花费晶体管的还有庞大的线程仲裁机制、端口、缓存和寄存器等等周边资源。NVIDIA为了TLP(线程并行度)付出了太多的代价,而这一切代价,都是为了GPU能更好地运行在各种复杂环境下。

但是业界普通的共识是SIMD结构的流处理器设计能够有效降低晶体管使用量,特别是在已经设计好的架构中扩展流处理器数量的难度,比起MIMD结构要容易很多。对比R600和G80架构可知,4个1D标量ALU和1个4D矢量ALU 的理论运算能力是相当的,但是前者需要4个指令发射端和4个控制单元,而后者只需要1个,如此一来MIMD架构所占用的晶体管数将远大于SIMD架构。

ATI Catalyst AI带来性能提升

● ATI Catalyst AI带来性能提升

在2004年,伴随着X700系列显卡的发布,ATI公司在它的驱动上新增加了一些其他的额外功能。目前我们到手的Catalyst最新版本拥有一项叫做Catalyst AI.的新技术。事实上,ATI拥有Catalyst最新版本的所有优化功能,并增加了一些其它的新特性。同时把这些优化功能和新特性归类为一个包。

Catalyst AI 技术的无论是高低设置都可以通过调整纹理滤波功能来提高性能。它们为了提高图像质量也做了相应的调整。无论在任何一个纹理时期,ATI不再会使各向异性滤波里下降为双线性滤波。(以前,如果对象最初的纹理不是最高的解决方案,一般会使用双线性滤波),如果Catalyst AI 技术被关闭掉,并且要求使用三线性滤波。那么这种方式现在可以完成任何事情。

ATI的Catalyst驱动

在测试了ATI现已公布的Catalyst支持的很多游戏之后,我们现在能够来评估一下他们的功能。他们表示过努力做到几乎没有画质上的区别,在观看游戏的时候,我们发现确实是这样。当然,我们最好在3D和UT2K4(仅仅当AA/AF激活)游戏中去观察所有的真正的改进。或许现在已经有针对“Catalyst AI”(bete驱动)特性的文章译本,或者或许对于我们测试的游戏实际上并没有性能的差别。通常我们使用更高性能的硬件突出表现在小的优化和性能的增强,并且这些游戏不应该被系统的其它方面限制。而我们对ATI明显的满意是它避免了降低到双线性过滤。

就性能来说,最新的Catalyst 10.3系列驱动在《Dirt 2》、《Tom Clancy's H.A.W.X》等官方列表提及的游戏中,确实存在较大的性能提升,不过我们对比了开启和关闭Catalyst A.I后的画质,在细节方面的变化则是难以察觉的,相信玩家在激烈的游戏当中亦不能分辨在画质上区别。

通过CATALYST A.I,用户可以在当今顶级主流游戏中得到性能提升以及全方位的游戏新体验。要说明的是,取得这样的性能提升并不是建立在牺牲画质的基础上的。由于当前开发人员在制作游戏时会使用很多不同的方法,所以已往很难去针对每一个游戏进行优化。而借助CATALYST A.I.工具,我们可以更高的解决这种不一致的情况,同时为用户带来更好的游戏体验。此外,如果没有多余的优化应用,那么游戏将按照开发者的原意进行。当程序需要时,优化措施将开始进行。

环境光遮蔽选项在NVIDIA的控制面板中默认关闭

“环境光遮蔽”(Ambient Occlusion,AO)是一种非常复杂的光照技术,通过计算光线在物体上的折射和吸收在受影响位置上渲染出适当的阴影,进一步丰富标准光照渲染器的效果。“屏幕空间环境光遮蔽”(SSAO)就是该技术的一个变种,现已用于《Crysis》、《S.T.A.L.K.E.R.:晴空》、《火爆狂飙》、《鹰击长空》、《帝国:全面战争》等游戏。

NVIDIA从GeForce 185.20 Beta驱动开始就引入了环境光遮蔽特效,最新泄露的185.65 Beta版同样支持该技术,不过仅限Windows Vista/7操作系统下。AO和SSAO非常消耗资源,开启后会造成游戏帧率大幅降低,所以只推荐高端显卡用户使用,NVIDIA驱动中的AO选项也是默认关闭的。

ATI CATALYST A.I.功能通过对纹理滤波的控制,在特定的情况下,尤其是高分辨率或高画质特效下,有效的提升了系统的实际3D效能。但在部分的OpenGL游戏中,CATALYST A.I.的开启对3D效能提升并非十分明显,相信随着ATi的不断努力,CATALYST A.I.的潜力将会得到更好的发挥。

Havok引擎与CPU+GPU异构运算

● Havok引擎与CPU+GPU异构运算

目前在游戏中应用最广的物理效果有粒子、流体、软体、关节和布料五大类,借助这些效果,我们的图形世界将会变得更加真实细致。从游戏发展的轨迹来看,大家都在力求一种“现实”的效果,从最1994年Doom Ⅱ那种粗糙的3D效果到2008年的Crysis,游戏的3D效果和光影效果都有了长足的进步。如何让游戏表现出更真实的一面,放在大家面前的有两条路。第一条就是增加特效,如DX8、DX9、DX10,这样的特效更多表现的是一种“静态”的效果。而另一条路则是增加如爆炸、布料摆动、关节运动等“动态”方面的真实效果。

物理运算有两大特点,第一是高并行度,第二是高运算密度,这两大特点刚好符合我们之前所分析的并行计算结构,所以从物理效果提出之时,人们就在寻找加速比更高的硬件解决方案来进行物理运算。AGEIA公司在GDC2005游戏开发者大会上推出了物理处理器PPU(Physics Processing Unit),被称为05年度图形领域的重大技术创新。这种芯片可以通过其内部的大量并行浮点处理器来运算物理特效,解放任务繁重的CPU。不过PPU的劣势就是需要附加运算卡才能实现,功能较为单一,整体实现成本方面也没有做到最优。

物理引擎发展的挑战与应对

随后使用GPU进行物理加速走进了人们的视野,GPU天生拥有较高的并行度,同时其内部可编程浮点单元能够执行物理运算。同时随着GPU内部结构不断完善,调度器、发射端和寄存器资源已经能够支撑GPU进行损失较小的上下文切换,这是GPU在执行图像渲染的同时进行物理加速工作的前提。而NVIDIA和AMD也都选择了相应的物理加速引擎为自己服务。

和现在广为人知的PhysX物理引擎相对的是AMD选择的Havok物理引擎,这是业界知名度最高的拥有广泛游戏资源支持的物理引擎。Havok发展到2005年的时候,已经可以在微软的视窗操作系统、Xbox与Xbox360,任天堂的GameCube与Wii、索尼的PS2、PS3与PSP、苹果电脑的Mac OS X、Linux等操作系统或游戏主机上使用。此游戏引擎是用C语言/C++语言所撰写而成。

2006年,Havok物理引擎在基于CPU系统上获得众多支持的时候终于决定转向GPU系统,Havok FX引擎应运而生。Havok FX将物理运算分为特效和游戏运算,特效运算(如爆炸时的烟雾)将会由GPU的Shader Model 3.0来进行运算,进而减轻CPU的负担。而游戏物理运算则仍然由CPU处理。

但是随着Havok被Intel收购,基于GPU的物理引擎开发几乎陷入停滞。因为Intel当时的CPU发展思路已经转向了提高并行度,同时Intel程序中充满分支和循环嵌套的物理特效在GPU上难以完成,所以Intel让更多物理效果在CPU上运行。但是后期的GPU发展远超Intel预料,所以后期Havok还是和AMD不断合作谋求在GPU带来的更高加速比。

在GDC09展览中,演示中的Havok引擎使用了ATI的显示核心作为加速。由于引擎是基于OpenCL架构进行开发,所以处理器和显示核心都可以为其进行计算。基于GPU的Havok引擎发展,意味着AMD提倡多年的异构计算模式终于在更多领域找到了用武之地。虽然目前Havok引擎在GPU上的游戏数量少之又少,但是Havok引擎在CPU支持方面垄断了绝大部分游戏的物理加速接口。同时随着更多的CPU-GPU异构模式Demo推出,物理运算加速比相比纯GPU模式将会更好。

Eyefinity技术浅析及显示器摆放组合

● Eyefinity技术浅析及显示器摆放组合

我们知道,借助ATI Eyefinity技术,两个HD5750 CF以后可以实现不同方式的三屏输出,而NVIDIA GTX400系列的单卡是实现不了的。要实现同样的大屏幕,GTX400系列平台要花费更多的费用来购买显示器。同时在CF和SLi的对比上,AMD的CF交火技术通用性更好。因为无论是AMD的平台还是Intel的平台,CF都能过获得支持。这两个方案间的可视范围和性价比,我想任何一个普通消费者都能够比较出来。下面让我们进入正题:

Eyefinity

根据AMD官方资料我们可以了解到,服务于Radeon HD 5000系列产品的图形核心,均能实现最多6个显示通道的2560*1600分辨率(此时需要全部使用Display Port接口),每个显示通道均能实现10-bit色彩输出,而且Eyefinity技术下的多屏组建方式非常多元化,不仅拘泥于前文展示的横向或纵向一字排列。

Eyefinity在单核心模式下最高能够实现8192*8192(6710万像素)分辨率,这也就为该技术实现6台30吋显示器7680*3200分辨率提供技术基础。而且值得一提的是,根据上图我们能够了解到,如果想使用Eyefinity技术最好使用Display Port接口,因为图形核心支持的6条显示通道只能通过Display Port接口实现Dual-Link信号输出,如果使用DVI接口必须占用两条图形核心显示通道实现Dual-Link信号输出。而例如D-Sub和HDMI 1.3a规范的接口目前只能实现Single-Link(1920*1200)的视频信号,所以它们会占用一条图形核心显示通道。

PS:2010年1月7日在美国拉斯维加斯举办的CES上,HDMI正式发布1.4版本规范,能够实现4K级的分辨率,HDMI 1.4将是未来的一个重要显示输出接口规范。

目前AMD官方发布的Radeon HD 5000系列产品中,Radeon HD 5750级别以上公版产品均标配DVI*2 + HDMI +Display Port接口。较为低端的其他Radeon HD 5000系列产品在接口选择上较为自由,D-Sub、HDMI、DVI和Display Port四种接口根据各品牌商自由组合。例如低端的Radeon HD 5670公版产品就是采用DVI + Display Port + HDMI的组合。

AMD的官方文档中还为我们提供了Eyefinity技术下,如何搭配3屏、4屏乃至6屏的组建方式方法,其灵活的搭配方式,已经超出简单的桌面拓展。

不过官方列出的多屏Eyefinity组合图例并不详致,所以我们看上图6种实际举例图示。

通过此图例我们能够了解到,Eyefinity技术不仅仅能够实现单一的多屏拼接技术。例如上图中图例一、二、四分别是我们常见的组合方式,在此就不赘述。

图例三、五、六中是本环节要着重介绍的,我们看到在每个显示器上都标识有1、2、3、4等,此处这些数字表示在Eyefinity多屏系统下的组别,相同数字为同组。图例(三)的四台显示器Eyefinity模式,其中下面三台进行多屏拼接,而上面表示为2号的显示器可以进行桌面拓展或复制功能。同理在图例(五)和图例(六)中,标识为1的组别显示器组建多屏拼接,其他独立显示器2、3、4进行桌面拓展或者桌面复制功能。

值得注意的是从上面所有展示图例来看,目前Eyefinity技术还无法实现2组以上(每组两台显示拼接)的模式。

Fermi功耗与温度表现不容忽视

● Fermi功耗与温度表现不容忽视

Fermi架构的GTX400系列显卡在晶体管数量方面达到了创记录的32亿个,但是32亿个晶体管几乎触碰了TSMC 40nm制程工艺极限,最后导致了GTX480和GTX470的发热量过大,功耗方面,单卡单芯的GTX480几乎能和单卡双芯HD5970相比。不可否认的是这是一个让所有用户感到不可思议的结果。

在基于Fermi架构的产品大面积上市之后,我们对GTX480和GTX470做了发热和功耗测试,相信经常来中关村在线看显卡评测的读者已经熟知了这些数据,不过今天我们还是需要将这些测试结果放出以便用户参考。

我们的测试是在室温26度的环境中进行的,使用送测产品的则是NVIDIA公版显卡。我们使用了Furmark 1.8.0软件来测试GPU功耗和发热,软件自动生成温度曲线。实际上芯片的最大功耗需要使用调节电平的方式获得,OCCT软件是一个比较合适的选择。但是AMD和NVIDIA都认为Furmark通过重负载渲染可以作为一个较为公平的功耗或发热考核方法。

GTX470温度曲线

通过上图我们得到了GTX480产品的温度曲线,我们这款显卡在待机时可以维持64度,但是满载最高温度达到了95度,最后是在风扇转速92%的镇压下稳定在91度,这个结果的确不能让大多数追求平衡的用户满意,当然追求极致性能的用户可能不会在乎这种风扇转速。但是不可否认的是一款民用级别显卡达到如此温度,已经严重影响了用户的正常使用。

GTX470在温度方面表现略微好转,测试起始温度67度,最高温度没有超过85度。但是这种温度的获得,仍然需要抬高风扇转速来获得,总体来说这的确不是一个令人满意的结果。

功耗检测部分,我们使用Seasonic PowerAngel功率计测试整个系统的实时功率,CPU关闭了EIST等自动降频功能以减少误差,空载为系统进入操作系统待机时、满载为运行Fumark + GPU-Z软件烤机模式,取值均是相当长一段时期观察达到过的最大值。

GeForce GTX 400系列标配的GF100核心拥有32亿晶体管,它有上面的表现笔者并不意外。在待机状态下GeForce GTX 400系列表现不多,与同为40nm的Radeon HD 5800系列实力相当。但是在满载测试中,32亿晶体管弊端显露无疑,GeForce GTX 480单卡平台满载功耗高达466瓦,而GeForce GTX 480 SLI平台更是达到了820瓦。总而言之GeForce GTX 480功耗控制不佳,而之后则导致了GTX400全系列产品的功耗控制能力不让用户满意。

在TSMC 40nm制程工艺的帮助之下,这款不同数量流处理器的两个版本HD5670显卡的节能特性再一次得到体现,虽然其对手GT240能够以更低的功耗运行,但是与其性能相近的9800GT,只能因为55nm制程工艺而忍受较高的满载功耗。同时9800GT的性能总体上还是无法和HD5670抗衡。

400/640流处理器HD5670规格解析

● 400/640流处理器HD5670规格解析

在2010年初发布的老版本Radeon HD 5670使用了原生Redwood XT核心,集成6.27亿个晶体管。作为首款低于100美元的DirectX 11产品,正如上文提及这是与GeForce GT 240针锋相对的设定。而且与GeForce GT 240一样,Radeon HD 5670分为512MB版本和1024MB版本,价格上512MB版本在649元至699元,1024MB版本在749元至799元。

本次发布的HD5670并不是其升级版,而是使用了集成度高达10.40亿个晶体管的Juniper CE核心。这款GPU核心频率750MHz,流处理器数量为640个,纹理填充率为25.12GTexels/s,采用GDDR5显存,显存频率为1000MHz(等效频率4000MHz),显存带宽64GB/s。

纯粹从核心的来源上来看,这款GPU是经过两次精简的。640SP新版Radeon HD 5670的核心为Juniper CE,实际上是由800SP的Juniper核心削减而来(原用于Radeon HD 5700系列),同样基于Radeon HD 5870架构,这一点有些类似于其他非HD5870的HD5000系列产品。

同时,HD5870附带的一系列优秀特性在HD5670这款产品当中也全部保留了下来。例如让玩家所熟知的Eyefinity技术、DirectX 11支持、Stream通用计算接口、40nm工艺等。

| AMD 新老 Radeon HD 5670 及 对 位 产 品 规 格 (ZOL 显 卡 频 道) | ||||

| 显卡型号 | Radeon HD 5670 | Radeon HD 5550 | Radeon HD 5670 640SP | GeForce GT 240 |

| 市场定价 | 699元 | 499元 | 650元 | 599-799元 |

| GPU工艺 | 40 nm | 40 nm | 40 nm | 40 nm |

| GPU晶体管 | 6.27 亿 | 6.27 亿 | 10.40 亿 | 7.27 亿 |

| 着色器数量 | 400 | 320 | 640 | 96 |

| 着色器组织 | (1D+4D) *80 | (1D+4D) *64 | (1D+4D) *128 | 1D *96 |

| ROPs数量 | 32 | 16 | 16 | 8 |

| 纹理单元数量 | 20 | 16 | 32 | 32 |

| 核心频率 | 775 MHz | 550 MHz | 650 MHz | 550 MHz |

| 着色器频率 | 775 MHz | 550 MHz | 650 MHz | 1340 MHz |

| 理论计算能力 | 620 GFLOPs | 352 GFLOPs | 832 GLOPs | 386 GFLOPs |

| 等效内存频率 | 4000 MHz | 1600 MHz | 4000 MHz | 3200 MHz |

| 内存位宽 | 128 bit | 128 bit | 128 bit | 128 bit |

| 内存带宽 | 64.0 GB/s | 25.6 GB/s | 64.0 GB/s | 51.2 GB/s |

| 内存类型 | GDDR5 | GDDR3 | GDDR5 | GDDR5 |

| 内存容量 | 512 MB | 512 MB | 512 MB | 512 MB |

| DX版本支持 | 11 | 11 | 11 | 10.1 |

| HD视频技术 | Avivo HD | Avivo HD | Avivo HD | PureVideo HD |

| 通用计算接口 | Stream | Stream | Stream | CUDA |

通过上表我们可以得出,这次发布的640流处理器版本的HD5670,实际上是AMD的HD5700系列产品,并非HD5600系列。新版的HD5670虽然没有达到Juniper核心的完整800个流处理器,但是其832GFLOPS的强大运算能力,还是让竞争对手NVIDIA感到汗颜。

在接下来的评测中,我们将使用大量基准和游戏测试来展示新老HD5670显卡在DirecX 9、10、11游戏中的表现,同时在相同价格上目前其竞争对手——市场上大量存在的Geforce 9800GT和现在NVIDIA在中端低市场唯一主推产品Geforce GT240的表现也将得到曝光,结合之前的技术分析,用户能够判断出DX11时代最新技术和标准的支持者,为自己的显卡选购做出更为理性的支持。

性能测试的硬件、软件平台状况

性能测试的硬件、软件平台状况

● 测试系统硬件环境

| 测 试 平 台 硬 件 | |

| 中央处理器 | Intel Core i7-870 OC3.5GHz |

| 散热器 | Thermalright Ultra-120 eXtreme |

| 内存模组 | Apacer 猎豹二代双通道套装/PC3-12800 |

| (SPD:1757 9-9-9-24-1T) | |

| 主板 | ASUS P7P55D |

| (Intel P55 + ICH10R Chipset) | |

| 显示卡 | |

| AMD 产 品 | |

| Radeon HD 5670 400SP | |

| (RV8X0 / 512MB / 核心:7500MHz / Shader:775MHz / 显存:4000MHz) | |

| Radeon HD 5670 640SP | |

| (RV840 / 512MB / 核心:750MHz / Shader:750MHz / 显存:4000MHz) | |

| NVIDIA 产 品 | |

| GeForce 9800GT | |

| (G92 / 512MB / 核心:650MHz / Shader:1650MHz / 显存:1800MHz) | |

| GeForce GT 240 | |

| (G215 / 512MB / 核心:550MHz / Shader:1340MHz / 显存:3200MHz) | |

| 硬盘 | Hitachi 1T |

| (1TB / 7200RPM / 16M | |

| 电源供应器 | AcBel R8 ATX-700CA-AB8FB |

| (ATX12V 2.0 / 700W) | |

| 显示器 | DELL UltraSharp 3008WFP |

| (30英寸LCD / 2560*1600分辨率) | |

ASUS P7P55D

Thermalright Ultra-120 eXtreme

我们的硬件评测使用的内存模组、电源供应器、CPU散热器均由COOLIFE玩家国度俱乐部提供,COOLIFE玩家国度俱乐部是华硕(ASUS)玩家国度官方店、英特尔(Intel)至尊地带旗舰店和芝奇(G.SKILL)北京旗舰店,同时也是康舒(AcBel)和利民(Thermalright)的北京总代理。

● 测试系统的软件环境

| 操 作 系 统 及 驱 动 | |

| 操作系统 | |

| Microsoft Windows 7 Ultimate RTM | |

| (中文版 / 版本号7600) | |

| 主板芯片组 驱动 |

Intel Chipset Device Software for Win7 |

| (WHQL / 版本号 9.1.1.1125) | |

| 显卡驱动 | |

| AMD Catalyst for Win7 | |

| (WHQL / 版本号 10.7) | |

| NVIDIA Forceware for Win7 | |

| (WHQL / 版本号 258.96) | |

|

|

2560*1600_32bit 60Hz |

| 测 试 平 台 软 件 | ||

| 3D合成 测试软件 |

3Dmark 06 | |

| Futuremark / 版本号1.10 | ||

| 3Dmark Vantage | ||

| Futuremark / 版本号1.01 | ||

| 3D游戏 测试项目 | ||

| DirectX 9游戏 | ||

| Call of Duty 6:Modern Warfare 2 | ||

| Activision / 版本号 1.0 | ||

| DirectX 10游戏 | ||

| Crysis | ||

| Crytek / 版本号1.2.1 | ||

| DirectX 10.1游戏 | Farcry 2 | |

| Ubisoft / 版本号 1.0 | ||

| Tom Clancy's H.A.W.X | ||

| Ubisoft / 版本号 1.0 | ||

| DirectX 11游戏 | Colin McRae DiRT 2 | |

| Codemasters / 版本号 1.0 | ||

| Heaven Benchmark | ||

| UNIGINE / 版本号 1.0 | ||

| Heaven Benchmark | ||

| UNIGINE / 版本号 1.2 | ||

| Aliens Vs. Predator | ||

| Rebellion | ||

| 辅助测试软件 | Fraps | |

| beepa / 版本号 3.1.2 | ||

各类合成测试软件和直接测速软件都用得分来衡量性能,数值越高越好,以时间计算的几款测试软件则是用时越少越好。

DX9理论性能测试:3DMark 06

● DX9理论性能测试:3DMark 06

3Dmark 06作为上一代3DMark系列巅峰之作,所有测试都需要支持SM3.0的DirectX 9硬件,并且支持HDR特性,这款软件的最终得分里CPU性能占有不小的权重,因此它更适宜分析整个系统的3D加速能力。

DX10理论性能测试:3Dmark Vantage

● DX10理论性能测试:3Dmark Vantage

3DmarkVantage是Futuremark最新推出的一款显卡3D性能测试,该款软件仅支持DirectX 10系统及DirectX 10显卡。测试成绩主要由两个显卡测试和两个CPU测试构成,整个测试软件各家偏重整机性能。

DX9游戏测试-使命召唤6现代战争2 2

● Call of Duty: Modern Warfare 2

《使命召唤6:现代战争2》完全可以被形容为一款如过山车一样充满了惊险刺激的射击游戏。它时而用节奏快到令人窒息的紧张追逐战将你甩上高空,时而又用稳扎稳打、步步为营的狙击战把你抛至谷底,而且游戏的流程长度基本跟《使命召唤4:现代战争》保持了一致,所以带来的乐趣总是那么短小精悍,却叫人回味无穷。坚毅难度下(普通的下一个难度级),完成战役模式大约在7个小时,与《使命召唤4:现代战争》差不多,但整体节奏要更紧凑了,场面也更火爆。

>>游戏类型:DirectX 9.0c 第一人称射击游戏

>>测试方式:黑夜室外/室内场景,沿同一固定路线跑完3次取平均值,Fraps计速

>>画质设定:可设置的全部最高

DX10游戏测试-Crysis

● Crysis

跳票多时、万众期待的DirectX 10游戏大作Crysis,把目前PC 3D娱乐的视觉体验发挥到极致的游戏,大量使用DirectX 10的硬件功能,对显卡的负载也提升至空前水平。

>>游戏类型:DirectX10 第一人称视角射击游戏

>>测试方式:游戏自带GPU性能测试工具,为3D实时运算的飞行过场回放

>>画质设定:全部最高

DX10.1游戏测试-FarCry2

● FarCry2

使用CryENGINE®和PolyBump™折服世人的经典之作FarCry推出了第二代作品——FarCry2,这款作品无论是游戏引擎还是画面设计都有了长足进步,该作仍然由Ubisoft发布。

>>游戏类型:DirectX10 第一人称射击游戏

>>测试方式:游戏自带性能测试工具,内容为3D实时运算的战斗回放

>>画质设定:全部最高

DX10.1游戏-汤姆克兰西之鹰击长空

● Tom.Clancys.H.A.W.X

《Tom.Clancys.H.A.W.X》由Ubisoft的Bucharest Studio负责开发,玩家可以在游戏中驾驶超过50种飞机进行空战.游戏的背景时间设定在2012年,那时的世界正越来越依赖于私人的军火公司(PMCs)。随着PMCs逐渐强大,世界正走向全球冲突的悬崖。这听起来好像是个足够充分的理由让玩家跳进自己的战斗机去干掉那些坏蛋。HAWX提供了名为“强化真实系统”(ERS)的特性,该系统甚至能够让一般的飞行员感觉像是Iceman。

>>游戏类型:DirectX10.1飞行类游戏

>>测试方式:沿同一固定路线跑完3次取平均值,Fraps计速

>>画质设定:全部最高

DX11游戏-科林麦克雷之尘埃2

● Colin McRae DiRT2

《科林麦克雷:尘埃》本身是一款为纪念去世的英国拉力赛车手科林.麦克雷(Colin McRae)而制作的游戏,因此在游戏过程中不难见到许多麦克雷过往的身影,距前作将近二年多之久的《科林麦克雷:尘埃2》于2009月12月11日正式发售。值得一提的是,这款游戏不仅拥有很高的可玩性,同时还是率先支持DirectX 11 API的游戏,一经上市就得到广大游戏爱好者争相追捧。

>>游戏类型:DirectX 11竞速类游戏

>>测试方式:

>>画质设定:全部最高

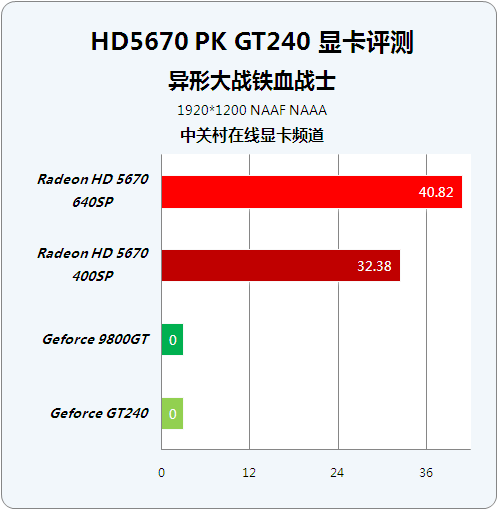

DX11游戏-异形大战铁血战士

● Aliens Vs. Predator

由Rebellion开发、世嘉发行的科幻射击游戏《异形VS铁血战士》(Aliens vs. Predator)现已确定发售日期。根据世嘉的《异形VS铁血战士》官方网页的信息,本作将于2010年2月19日上市,对应PC、PS3和Xbox 360平台。这部根据电影改编的游戏也同样存在着三方势力,一方是人类海军陆战队,一方是异形,还有一方是铁血战士,游戏中玩家可以选择的是海军陆战队或者是铁血战士甚至是异形。本作提供单人模式和多人模式。

>>游戏类型:DirectX11第一人称射击类游戏

>>测试方式:沿同一固定路线跑完3次取平均值,Fraps计速

>>画质设定:全部最高

DX11测试-Heaven Benchmark 2.0

● Heaven Benchmark 2.0

《Heaven Benchmark 2.0》是由俄罗斯Unigine游戏公司开发设计的一款Benchmark程序,该程序是由Unigine公司自主研发的游戏引擎设计,其支持DirectX 9、DirectX 10、DirectX 11与OpenGL 3.2 API,通过26个场景的测试最终得出显卡的实际效能。

>>游戏类型:DirectX 9/10/11及OpenGL Benchmark

>>

>>画质设定:全部最高

最令人兴奋的Direct3D新功能

● 最令人兴奋的Direct3D新功能

首款基于DirectX 11的Radeon HD5870显卡带给高端玩家前所未有的游戏体验,而HD5000家族的整体成型则将这种真实的游戏体验普及到更低价位。DirectX 11发布带来了很多令人兴奋的新特性,其中使用Computer Shader进行图形后处理和多线程渲染、乱序透明等功能都是以前的GPU硬件从未想过从未做过的。这些功能标识着GPU的发展结束了一位增强性能来获取更大浮点吞吐以适应增长的三角形数量和更复杂的Shader指令,而是转向使用使用先进渲染技术结合GPU通用计算来实现复杂特效。

回顾历次DirectX的更替过程,几乎都对GPU架构产生了颠覆性的影响,它们大部分要求GPU改变现有的着色器Shader单元结构,或者为着色器Shader单元追加资源,这些改进都是为了让GPU的指令数提升,寄存器数量增加,纹理规模提升,材质Texture精度提升。这样的改进难免带来晶体管数量的增长,也就说说GPU内部的每个着色器Shader单元变得更加庞大。

本次DirectX 11升级,我们看到以下特性是非常值得关注的:

● 着色器版本提升到Shader Model 5.0,采用面向对象的概念,并且完全可以支持双精度数据。

● Tessellation曲面细分技术获得微软正式支持,逐渐走向成熟;

● Multithreading多线程处理,让图形处理面对多线程编程环境不再尴尬;

● 提出微软自己的Compute Shader通用计算概念,把GPU通用计算推向新的巅峰;

● 新的Texture Compression纹理压缩方案,在画质损失极小的环境下带来了硬件资源的节约。

今天的测试重点是拥有DirectX 11支持的HD5670和不支持DirectX 11的NVIDIA Geforce GT240显卡,无论是整体性能还是DirectX 11特效测试,AMD显卡的整体优势都在各个测试项目中发挥的淋漓尽致。

NVIDIA在最近3年中更新了3次GPU硬件架构,它们分别是:

● 面向DirectX 10游戏设计以G80G92为主的第一代统一渲染架构

● 面向游戏和通用计算并重的GT200架构(不包含GT210 220 240)

● 面向大规模并行计算和游戏并重的Fermi GF100架构

而ATI在最近3年中,成功推出了4款GPU硬件架构,它们分别是:

● HD2000系列第一代统一渲染架构

● HD3000系列平衡和改进型统一渲染架构

● HD4000系列扩张型优化后端和增添LDS缓冲架构

● HD5000系列支持DirectX 11放大版优化通用计算统一渲染架构

几乎在每一代架构更替中,AMD都能通过其强大的细分市场能力制造出数量庞大而又密集的GPU产品线,NVIDIA的产品线则相对于单一,特别是在1000元以下市场很容易被对手包围。本次Fermi架构固然强大,但是至今未能衍生出低端的大量用户能够买得起的GPU产品。

640个流处理器版本的HD5670在命名方面虽然和老版本HD5670重合,但是却能给用户带来一种如同CPU“开核”般的感受。同时AMD打造的密集产品线已经让NVIDIA在低端市场压力更大,现在GTS450虽然发布在即,但是同样无法抵御500元以下AMD的疯狂进攻,越来越多的消费者也正在享受低价显卡的DirectX 11特性带来的使用体验,在丰富用户选择和保护用户投资方面AMD无疑为市场和用户做出了榜样。

- 相关阅读:

- ·量子点对决OLED:谁的显示效果更好?

//vga.zol.com.cn/555/5557292.html - ·高端的对决 R9-390X和GTX 980对比推荐

//vga.zol.com.cn/549/5491726.html - ·正面对决 非公版760和950谁更胜一筹呢

//vga.zol.com.cn/539/5390221.html - ·2015影驰杯英雄新星挑战赛上演巅峰对决

//vga.zol.com.cn/537/5378229.html - ·性能究竟能差多少 两代显卡DX12的对决

//vga.zol.com.cn/535/5351343.html